Kling Avatar:AI生成人間の未来を再定義

近年、人工知能(AI)は静止画像の生成から、長編の動的な動画の生成へと急速に進化しています。これらの進歩の中で、AI生成アバター(画面上で話したり、感情を表現したり、動作をしたりすることができる仮想人間)はイノベーションの焦点となっています。しかし、HeyGenやSynthesiaなどのツールを使用しても、不自然なリップシンク、硬い表情、一貫性のないアイデンティティといった課題は依然として残っています。

そこで登場したのが、クイックショーのAIチームによって開発された画期的なシステム「Kling Avatar」です。このシステムはデジタルヒューマンの可能性の限界を押し広げ、自然に動き、話す超リアルなアバターを生成するように設計されており、AI駆動型の動画合成における大きな飛躍を代表しています。

パート1. Kling Avatarとは?

Kling Avatarは、クイックショー(Kling AIチーム)によって開発された最先端のデジタルヒューマン生成モデルです。より広範なKling AIエコシステムの一環として構築され、特に「アバター層」——トーキングヘッド、表情、感情表現の生成を担当する部分——に焦点を当てています。

Kling AI全体としてはテキストプロンプトから長編の映画的シーンを生成することができますが、Kling Avatarは単一の側面に焦点を絞っています。すなわち、画像、テキスト、またはオーディオ入力に基づいて、非常にリアルで長時間のキャラクターアニメーションを生成することです。その結果、話したり表情を豊かに表現したりする、人間に酷似したアバターが誕生します。

パート2. Kling Avatarの仕組み:背後にある技術

Kling Avatarのコアには、2つの主要な技術によってAI動画生成の新しいパラダイムが導入されています:

- マルチモーダル大規模言語モデル(MLLM)ディレクター:

- カスケード式長時間生成:

このシステムはデジタルディレクターのように機能します。ユーザーのプロンプト(テキスト、音声、または画像)を解釈し、「設計図スクリプト」に構造化します。このスクリプトは、アバターが時間の経過に伴ってどのように動き、話し、感情を表現するかを定義します。

動画全体を一度に生成するのではなく(これによりアーティファクトや一貫性のなさが発生しやすくなります)、Kling Avatarはキーフレームに基づいて短くて一貫性のある動画セグメントを作成します。これらのセグメントは後でシームレスに結合され、長いシーケンス全体を通じて一貫したアイデンティティと自然な動きの流れが確保されます。

その結果は?現在のAI動画生成の環境において稀なことですが、数分にわたるパフォーマンスでも、同じ顔、声、感情のトーンを維持するアバターが実現されます。

Kling Avatarは他のAIアバターツールとどう違うのか

HeyGenやOmniHumanなどの他のAIアバタープラットフォームが印象的なテキスト読み上げアバターを提供していますが、Kling Avatarは、アイデンティティや一貫性を失うことなく、長時間で感情に富んだパフォーマンスを生成する能力によって自身を際立たせています。

多くのシステムが顔のチラつきやロボットのようなリップシンクに苦労しているのに対し、Kling Avatarはスムーズなトランジション、自然な目の動き、そして人間らしい体のジェスチャーを維持します。また、クイックショーの大規模な動画拡散インフラストラクチャの恩恵を受けており、強力な技術基盤を持っています。

ただし、Kling Avatarは現在、主に研究プレビューや内部テストを通じて利用可能であり、ほとんどのユーザーは完全な公開ツールではなくデモ版にのみアクセスできることを意味します。

パート3. Kling Avatarの主な特徴

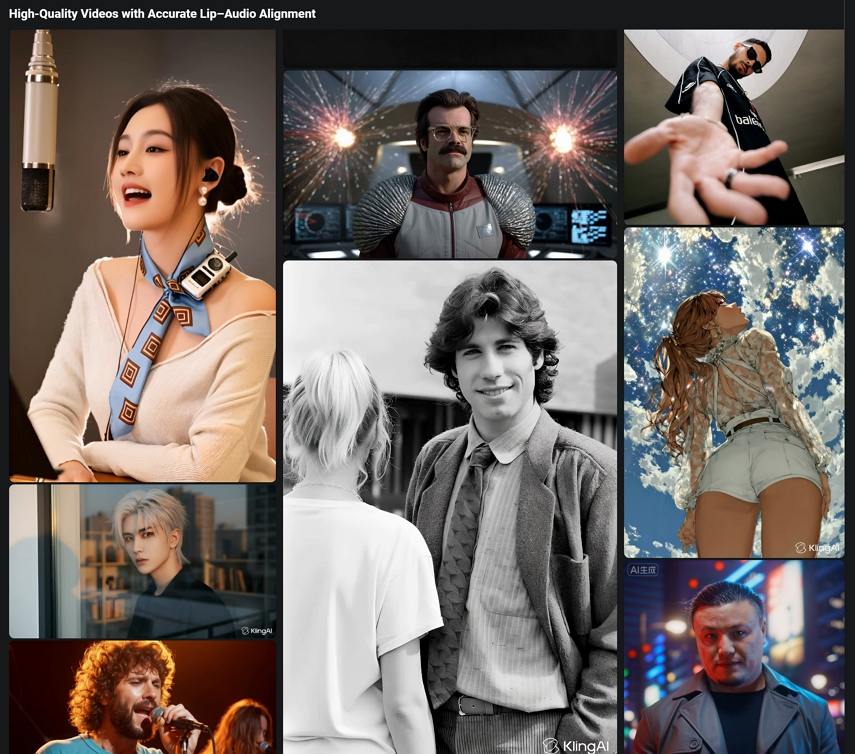

Kling Avatarは、AI生成キャラクターを生き生きとさせる印象的な範囲の特徴で際立っています:

- 高精度リップシンク:

- 感情のリアリズム:

- 長時間の一貫性:

- マルチモーダル制御:

- 実世界のアプリケーション向け最適化:

口の動きと話されたダイアログの間でほぼ完璧なアライメントを実現し、複数の言語とアクセントをサポートします。

微妙な表情、目の動き、ジェスチャーを捉えて、本物の感情を伝えます。

数分にわたる動画全体で、同じ顔の特徴、ヘアスタイル、照明条件を維持します。

テキスト、オーディオ、画像のプロンプトを受け入れ、クリエイターがパフォーマンスのスタイル、トーン、ペーシングをガイドできるようにします。

バーチャルインフルエンサー、トレーニングビデオ、マーケティングコンテンツ、またはデジタルストーリーテリングに適しています。

これらの機能により、Kling Avatarは2025年における最も高度なAIアバター生成システムの一つとなっています。

パート4. 実世界での応用

Kling Avatarは、産業界に広範な可能性を開きます:

- バーチャルインフルエンサー&コンテンツクリエイター:ソーシャルメディア、ライブストリーム、ショートフォーム動画のための人間に酷似したデジタルプレゼンターを簡単に作成できます。

- 企業研修&マーケティング:グローバルなオーディエンスのための多言語デジタルスポークスパーソンを生成できます。

- 映画&エンターテイメント:ストーリーボーディング、プレビジュアライゼーション、またはデジタルダブルにAIアバターを使用できます。

- 教育&ストーリーテリング:教えたり、ナレーションをしたり、インタラクティブなコンテンツをガイドしたりするためのパーソナライズされたアバターを設計できます。

Kling Avatarは、AIの創造性と映画的なリアリズムを融合することで、機械生成コンテンツと人間の感情の間のギャップを埋めています。

パート5. HitPaw VikPeaでKling Avatarの動画を強調する

Kling Avatarは非常にリアルなデジタルヒューマンを提供しますが、AI生成の動画は、特にエクスポートやプラットフォーム間で共有する際に、わずかなぼやけ、圧縮アーティファクト、または色の一貫性のなさといった一般的な課題に直面することがあります。

これらのAI生成クリップをよりシャープで映画的に見せるために、クリエイターはHitPaw VikPeaを使用できます。これは、解像度を向上させ、細部を復元し、視覚品質を手軽に強調するように設計されたプロフェッショナルなAI動画強調ツールです。

HitPaw VikPeaの機能:

- 動画の解像度を720pから4Kにアップスケールし、テクスチャを失うことがありません。

- 圧縮ノイズを低減し、拡散ベースのアーティファクトを滑らかにします。

- デジタルヒューマンの顔の細部を復元し、フレーム間のスムーズな動きを確保します。

- 破損した動画を修復し、背景を削除し、動画を安定させます。

HitPaw VikPeaを使用してKling Avatarの動画を強調する方法:

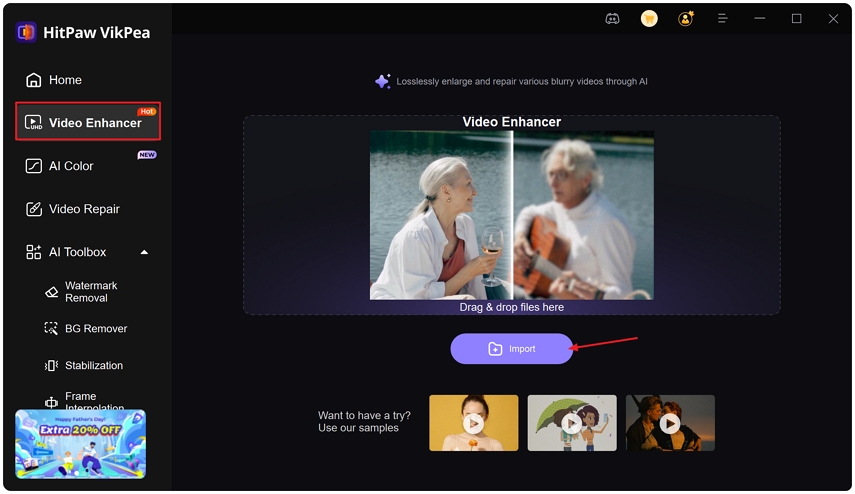

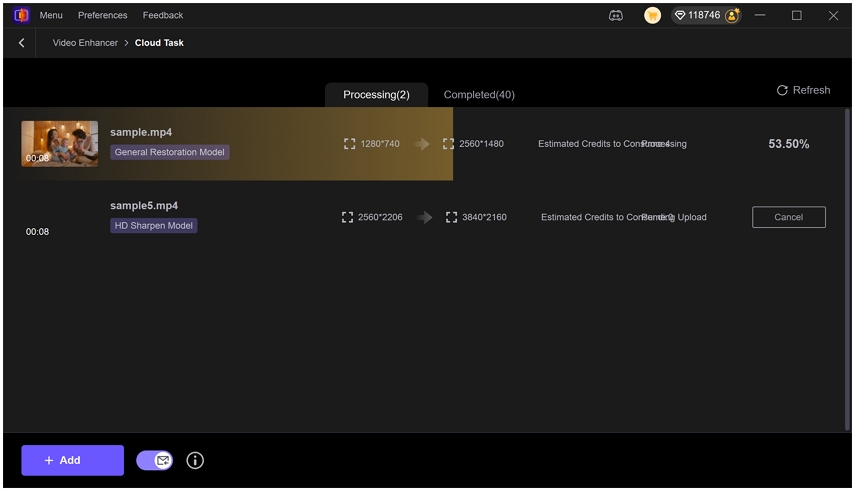

ステップ1.HitPaw VikPeaを起動し、左サイドバーから「Video Enhancer」を選択します。Kling Avatarの動画をインポートします。

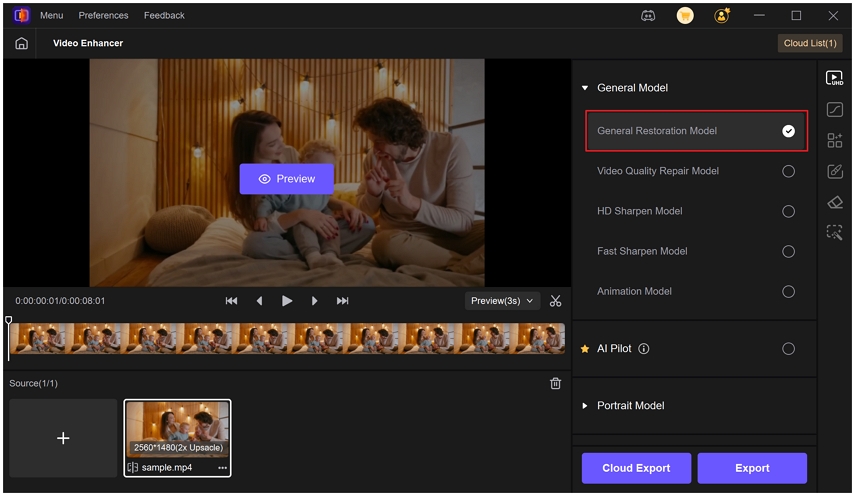

ステップ2.強調モデルを選択します。例えば、全体的な品質向上のための「General Restoration Enhancement」モデル、またはデジタルアバターのための「Portraint Model」を選択します。

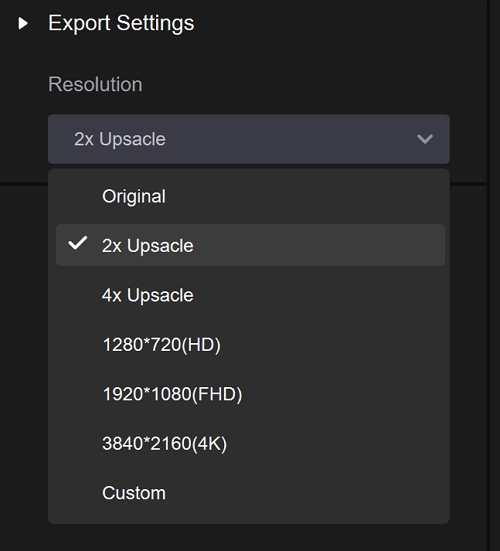

ステップ3.出力解像度、ビットレート、形式、保存パスなどの出力設定を行います。

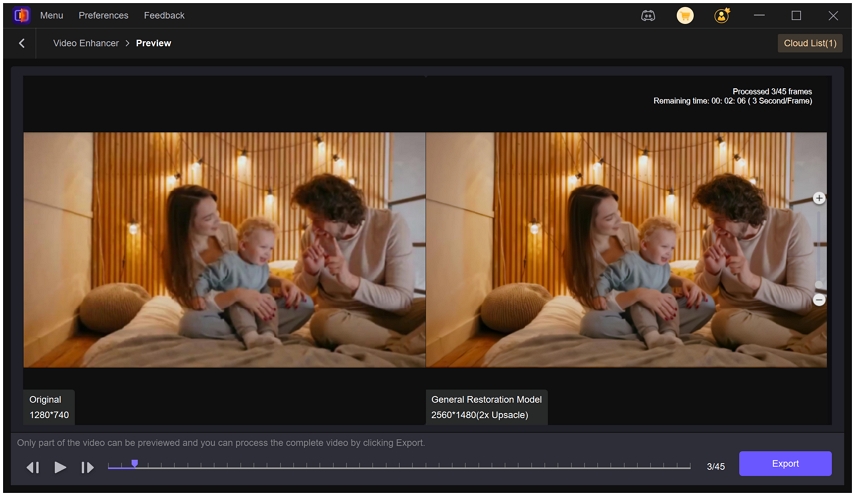

ステップ4.「Preview」ボタンをクリックして、スプリットスクリーンで比較を確認します。

ステップ5.すべて問題がなければ、「Export」ボタンをクリックして、強調された動画を保存します。

このプロセスにより、AI生成アバターはより自然でプロフェッショナルに見えるようになり、ソーシャルメディアのクリエイター、マーケター、またはより高い制作品質を求める動画編集者にとって最適です。

結論:AI駆動型デジタルヒューマンの未来

Kling Avatarは、AI動画生成の進化における画期的な瞬間を刻んでいます。マルチモーダル入力、感情知能、長時間の安定性を組み合わせることで、デジタルヒューマンをこれまで以上に映画的なリアリズムに近づけています。

この技術が成熟し続けるにつれ、人間のパフォーマンスとAIのパフォーマンスの境界はさらに曖昧になり、コンテンツ作成、ストーリーテリング、パーソナライゼーションのための新しい機会が開かれるでしょう。

そして、AIアバターをさらにシャープで人間らしく見せたいクリエイターにとって、HitPaw VikPeaのようなツールは完璧な仕上げの一役を担うことができます。生のAI出力を視覚的に見事なスタジオ品質の動画に変えることができるのです。

コメントを残す

HitPaw の記事にレビューを作成しましょう